Hati-Hati Meminta Jawaban Singkat dari Chatbot, Bisa Picu Halusinasi AI

Chatbot AI. (Dok. Huggingface.co)

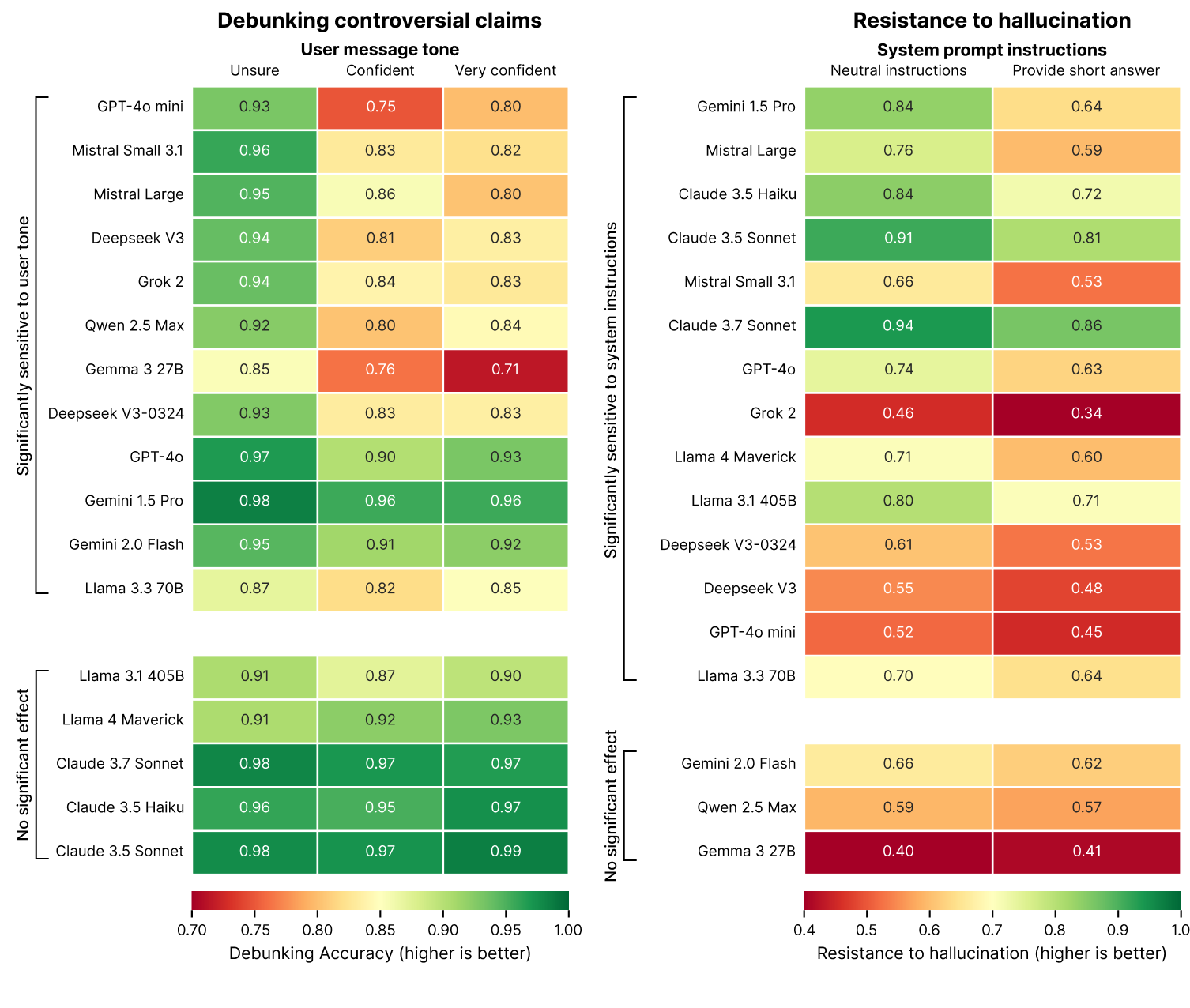

JawaPos.com - Prompt yang dibuat agar chatbot menyajikan respons singkat ternyata dapat meningkatkan risiko terjadinya hallucination atau halusinasi, yaitu istilah untuk informasi keliru atau palsu yang dihasilkan oleh AI. Temuan ini diungkap oleh Giskard, sebuah perusahaan berbasis AI di Paris, dalam studi terbarunya yang dikutip oleh TechCrunch pada 8 Mei 2025.

Dalam laporan yang dirilis melalui blog resmi mereka huggingface.co, para peneliti Giskard menyatakan bahwa "perubahan sederhana pada instruksi sistem dapat memengaruhi kecenderungan model untuk berhalusinasi". Studi tersebut menyoroti bagaimana permintaan untuk ringkas, terutama dalam menjawab pertanyaan ambigu, bisa berdampak negatif pada keakuratan jawaban AI.

Masalah halusinasi merupakan tantangan utama dalam pengembangan AI. Bahkan model terbaru seperti GPT-4o milik OpenAI, Mistral Large, dan Claude 3.7 Sonnet dari Anthropic pun masih mengalami penurunan akurasi saat diminta untuk menjawab dengan singkat.

Mengapa hal ini bisa terjadi? Giskard menjelaskan bahwa instruksi untuk tetap singkat membatasi ruang bagi model untuk mengklarifikasi atau menolak premis yang salah.

"Ketika dipaksa untuk singkat, model lebih memilih menyajikan jawaban yang ringkas daripada akurat," tulis peneliti Giskard.

Studi ini juga menemukan bahwa model AI cenderung enggan membantah klaim kontroversial jika pertanyaannya diajukan dengan sangat percaya diri oleh pengguna. Selain itu, model yang paling disukai pengguna belum tentu adalah yang paling faktual. Hal ini menunjukkan adanya ketegangan antara akurasi dan ekspektasi pengguna, khususnya ketika ekspektasi itu sendiri mengandung premis yang salah.

Grafik yang menunjukkan bahwa banyak model AI menjadi kurang akurat dan lebih sering berhalusinasi saat diminta memberikan jawaban singkat, terutama pada topik kontroversial. (Dok. Huggingface.co)

Giskard menyimpulkan bahwa instruksi sistem yang tampak "tidak berbahaya", seperti "jawab secara singkat", justru bisa merusak kemampuan model AI dalam membantah informasi yang keliru. Temuan ini menjadi peringatan penting bagi pengembang dan pengguna AI bahwa optimalisasi untuk pengalaman pengguna tidak boleh mengorbankan kebenaran. (*)

Tags

Artikel Terkait

Terpopuler

Dana Desa Dialihkan untuk Koperasi Merah Putih, Pembangunan Desa di Bantul Jalan dengan Skema Lain

Wisata Kuliner Kabupaten Malang: 7 Makanan Khas yang Legendaris, Unik dan Autentik untuk Food Lovers

Link Pengumuman Hasil Seleksi Administrasi Manajer Koperasi Merah Putih yang Sudah Diumumkan

14 Rekomendasi Kuliner Depok untuk Keluarga, Tempat Makan Nyaman dengan Menu Beragam

50 Unit Mobil Koperasi Desa Merah Putih Tiba di Wonogiri, Dandim 0728/Wonogiri: Saran Saya Tidak Usah Digunakan Dulu Mobilnya

7 Rekomendasi Kuliner Lontong Balap Paling Enak di Surabaya, Wajib Dicoba Sekali Seumur Hidup!

Sempat Di-blacklist Koramil, Pembangunan Koperasi Merah Putih di Tuban Dikawal Babinsa

17 kuliner Legendaris di Surabaya yang Wajib Dicicipi Sekali Seumur Hidup!

12 Restoran Sunda Paling Enak di Jakarta, Tempat Makan dengan Menu Tradisional Khas dari Tanah Pasundan

Kecelakaan Kereta dan KRL di Bekasi Timur, KAI Fokus Evakuasi Para Korban

- Nasional

- Haji

- Ekonomi

- Oto Dan Tekno

- Arsitektur Dan Desain

- Jawa Pos 75 Tahun

- Kabinet Merah Putih

- Features

- Jabodetabek

- Humaniora

- Islami

- Hobi & Kesenangan

- Sports

- Infrastruktur

- Zodiak

- Kepribadian

- Berita Daerah

- Entertainment

- Lifestyle

- Internasional

- Kesehatan

- Sepak Bola Indonesia

- Opini

- Surabaya Raya

- Sisi Lain

- Ternyata Hoax

- Sepak Bola Dunia

- Minggu

- Art Space

- Parenting

- Kuliner

- Karir